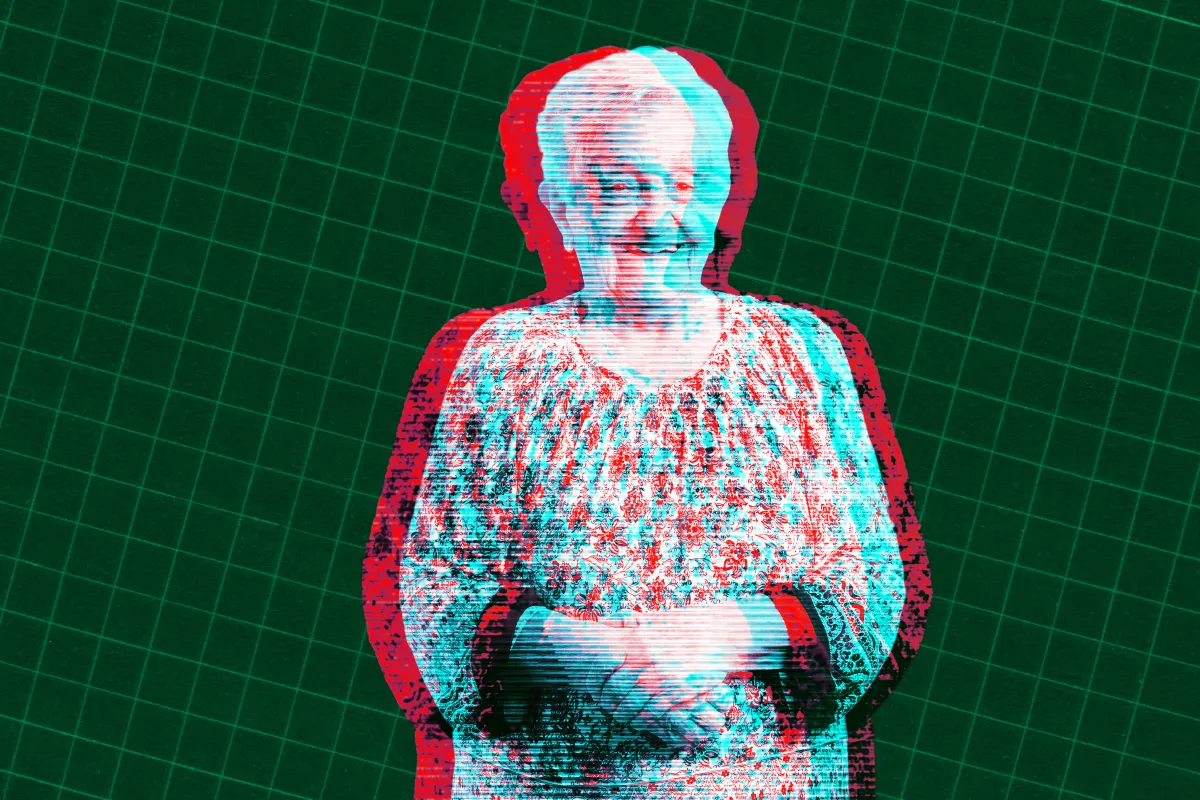

Una nueva demanda contra OpenAI alega que ChatGPT alimentó las delirantes paranoias de un hombre problemático, llevándolo a asesinar a su anciana madre y luego a suicidarse.

La demanda fue presentada contra OpenAI por el patrimonio de Suzanne Eberson Adams, una mujer de 83 años en Greenwich, Connecticut, quien fue asesinada por su hijo, Stein-Erik Soelberg, de 56 años. Como informó por primera vez The Wall Street Journal en agosto, Soelberg, quien vivía con su madre en el momento de los asesinatos, era un alcohólico con una larga y problemática historia de encuentros con la ley y había intentado suicidarse antes. En los meses anteriores a que Soelberg finalmente asesinara a su madre y tomara su propia vida, un vertiginoso conjunto de videos en redes sociales mostró que ChatGPT se había convertido en un confidente adulador, afirmando sus profundas delirantes paranoias de que estaba siendo vigilado y perseguido por un ominoso grupo de conspiradores —de los cuales, creía con el apoyo de ChatGPT, su madre era parte.

Ahora, el hijo sobreviviente de Soelberg, Erik Soelberg, está demandando a OpenAI, alegando que ChatGPT es un producto fundamentalmente inseguro y que las violentas muertes de su padre y su abuela fueron el resultado de potentes características de diseño —como la adulación y una importante mejora en la memoria entre conversaciones— que juntas crearon la tormenta perfecta de validación e hiperpersonalización que avivaron las llamas de la paranoia mortal de Soelberg.

«A lo largo de los meses, ChatGPT impulsó las más oscuras delirantes paranoias de mi padre y lo aisló completamente del mundo real,» dijo Erik Soelberg en un comunicado. «Puso a mi abuela en el corazón de esa delirante realidad artificial. Estas compañías tienen que responder por sus decisiones que han cambiado a mi familia para siempre.»

La demanda es la última de una creciente pila de litigios contra OpenAI y su CEO Sam Altman, alegando que ChatGPT-4o —una versión del chatbot fuertemente conectada al fenómeno más amplio de las delirantes paranoias de la IA y conocido por ser especialmente adulador— fue lanzado al mercado de manera imprudente a pesar de los riesgos previsibles para el bienestar de los usuarios. Y, en un interesante giro respecto a casos anteriores, este último archivo también nombra a Microsoft como demandado, alegando que Microsoft, un importante benefactor financiero de OpenAI, aprobó directamente el lanzamiento de ChatGPT-4o.

«OpenAI y Microsoft han lanzado algunas de las tecnologías de consumo más peligrosas de la historia,» dijo Jay Edelson, abogado principal del patrimonio de Adams, en un comunicado. «Y han dejado a Sam Altman, un hombre que piensa en la penetración de mercado en lugar de mantener a las familias seguras, al mando. Juntos, aseguraron que incidentes como este fueran inevitables.» (Edelson también representa a la familia de Adam Raine, un adolescente de 16 años en California que murió por suicidio después de extensas interacciones con ChatGPT, en su demanda contra OpenAI).

En un comunicado a los medios de comunicación, OpenAI describió el asesinato-suicidio como una «situación increíblemente desgarradora, y revisaremos los archivos para entender los detalles.»

«Continuamos mejorando el entrenamiento de ChatGPT para reconocer y responder a señales de angustia mental o emocional, desescalar conversaciones y guiar a las personas hacia apoyo en el mundo real,» continuó el comunicado. «También seguimos fortaleciendo las respuestas de ChatGPT en momentos sensibles, trabajando estrechamente con clínicos de salud mental.»

Microsoft no respondió inmediatamente a una solicitud de comentarios. Futurism informó anteriormente sobre un incidente en el que el chatbot Copilot de Microsoft —que utiliza la tecnología de OpenAI— alimentó la crisis de salud mental de un hombre esquizofrénico. Nuestro reportaje encontró que ese hombre fue arrestado y encarcelado por un delito no violento tras su decompensación estrechamente ligada a Copilot.

El montón de litigios contra OpenAI respecto a la salud mental de los usuarios sigue creciendo. Y dado el número de usuarios de ChatGPT que, según informes, muestran signos de crisis de salud mental en una base semanal, bien podríamos ver más.

«Era evidente que estaba cambiando, y ocurrió a un ritmo que no había visto antes,» dijo Erik, quien perdió tanto a su padre como a su abuela, al WSJ sobre la obsesión de su padre con ChatGPT —y cómo esa obsesión, a su vez, lo cambió.

«Pasó de ser un poco paranoico y un tipo raro,» continuó Erik, «a tener algunos pensamientos locos de los cuales estaba convencido que eran verdaderos debido a lo que hablaba con ChatGPT.»

Para saber más sobre ChatGPT: ChatGPT ahora está vinculado a muchas más muertes que la limonada con cafeína que Panera retiró del mercado en desgracia.

Con información de https://futurism.com/artificial-intelligence/openai-sued-murder-suicide