Claro, aquí tienes el contenido traducido y reescrito:

Recientemente, investigadores se han sorprendido al descubrir que los sistemas de inteligencia artificial (IA) diseñados para detectar cáncer presentan un alarmante sesgo racial.

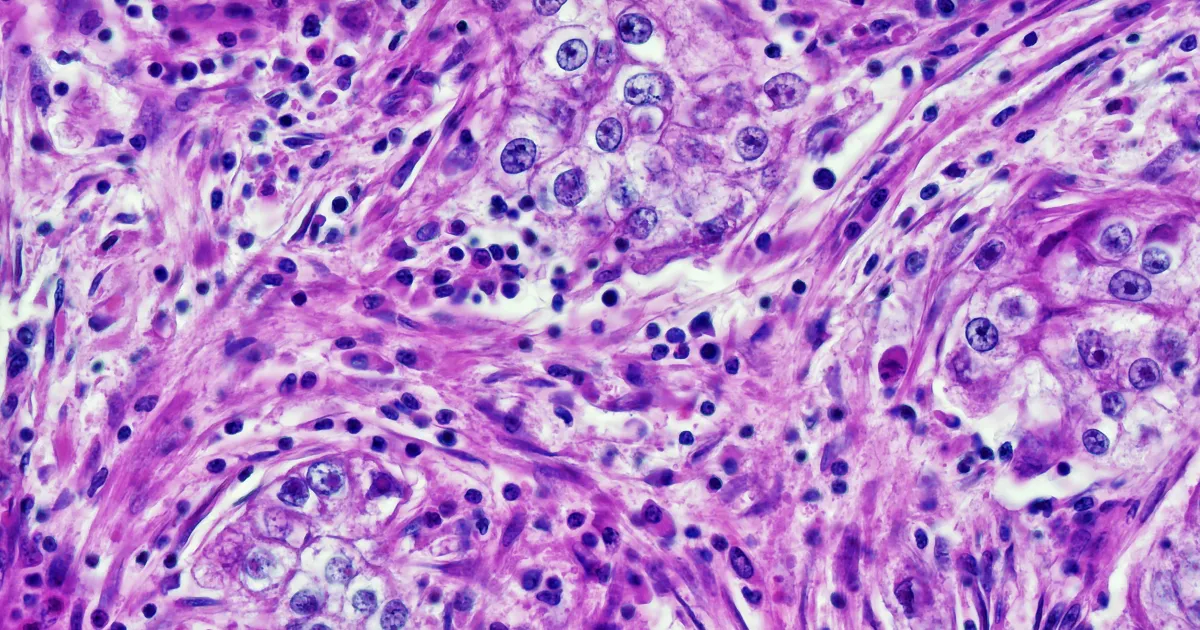

Estos hallazgos se publicaron en la revista Cell Reports Medicine, revelando que cuatro sistemas de diagnóstico patológico mejorados con IA muestran variaciones en precisión según la edad, género y raza de los pacientes. Estos datos demográficos son, inquietantemente, extraídos directamente de las diapositivas patológicas, algo que es prácticamente imposible para los médicos humanos.

Para llevar a cabo el estudio, los investigadores de la Universidad de Harvard analizaron casi 29,000 imágenes de patologías relacionadas con el cáncer de aproximadamente 14,400 pacientes. Su análisis reveló que los modelos de aprendizaje profundo mostraron sesgos preocupantes en un 29.3% de los casos, es decir, en casi un tercio de todas las tareas diagnósticas que se les asignaron.

“Descubrimos que, debido a la potencia de la IA, puede diferenciar muchas señales biológicas sutiles que no pueden ser detectadas por la evaluación estándar humana,” comentó Kun-Hsing Yu, investigador de Harvard y autor sénior del estudio. “Leer datos demográficos de una diapositiva patológica se considera una ‘misión imposible’ para un patólogo humano, por lo que el sesgo en la IA patológica nos sorprendió.”

Yu explicó que estos errores basados en sesgos son consecuencia de que los modelos de IA dependen de patrones vinculados a diversas demografías al analizar tejidos cancerosos. En otras palabras, una vez que las herramientas de IA identifican la edad, raza o género de una persona, esos factores moldean el análisis del tejido. A menudo, la IA replica el sesgo derivado de las lagunas en los datos de capacitación.

Por ejemplo, las herramientas de IA podían identificar muestras tomadas de personas negras. Estas diapositivas de cáncer presentaban un conteo más alto de células neoplásicas anormales y un conteo más bajo de elementos de apoyo en comparación con las de pacientes blancos, lo que permitía a la IA detectarlas, a pesar de que las muestras eran anónimas.

El problema surgió cuando una herramienta de patología de IA identificaba la raza de una persona, obsesionándose excesivamente con encontrar análisis previos que coincidieran con ese identificador. Sin embargo, cuando el modelo se entrenó principalmente con datos de personas blancas, las herramientas tenían dificultades para analizar a aquellos que no estaban tan representados. Las IA tenían problemas para distinguir subclases de células de cáncer de pulmón en personas negras; esto no se debía a la falta de datos sobre el cáncer de pulmón, sino a que había escasez de datos específicos sobre células de cáncer de pulmón de personas negras.

Esto fue inesperado, comentó Yu, “porque esperábamos que la evaluación patológica fuera objetiva. Al evaluar imágenes, no necesitamos conocer necesariamente la demografía del paciente para hacer un diagnóstico.”

En junio, investigadores médicos descubrieron un sesgo racial similar en herramientas diagnósticas psiquiátricas basadas en modelos de lenguaje grande (LLM). En ese caso, se mostró que las herramientas de IA a menudo proponían «planes de tratamiento inferiores» para pacientes negros cuando su raza era conocida.

Para abordar este problema en las herramientas de detección de cáncer, el equipo de investigación de Harvard desarrolló un nuevo enfoque de capacitación de IA llamado FAIR-Path. Al introducir este marco de capacitación a las herramientas de IA antes del análisis, lograron reducir un 88.5% las disparidades en su rendimiento.

Aunque es alentador saber que hay soluciones, el 11.5% restante sigue siendo preocupante. Hasta que marcos de capacitación como este se hagan obligatorios en todas las herramientas de IA en el ámbito patológico, las preguntas sobre los sesgos inherentes del sistema continuarán.

Si necesitas algo más, no dudes en pedirlo.

Con información de https://futurism.com/health-medicine/ai-cancer-diagnostic-bias