Claro, aquí tienes una traducción y reescritura del contenido:

—

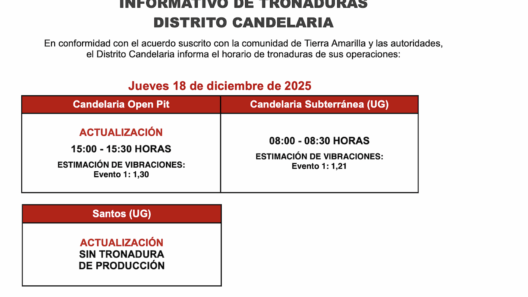

La semana pasada, los estudiantes de la Escuela Intermedia Lawton Chiles en Florida fueron llevados a un estado de emergencia tras un aviso de un sistema de vigilancia AI que detectó a un estudiante portando un arma.

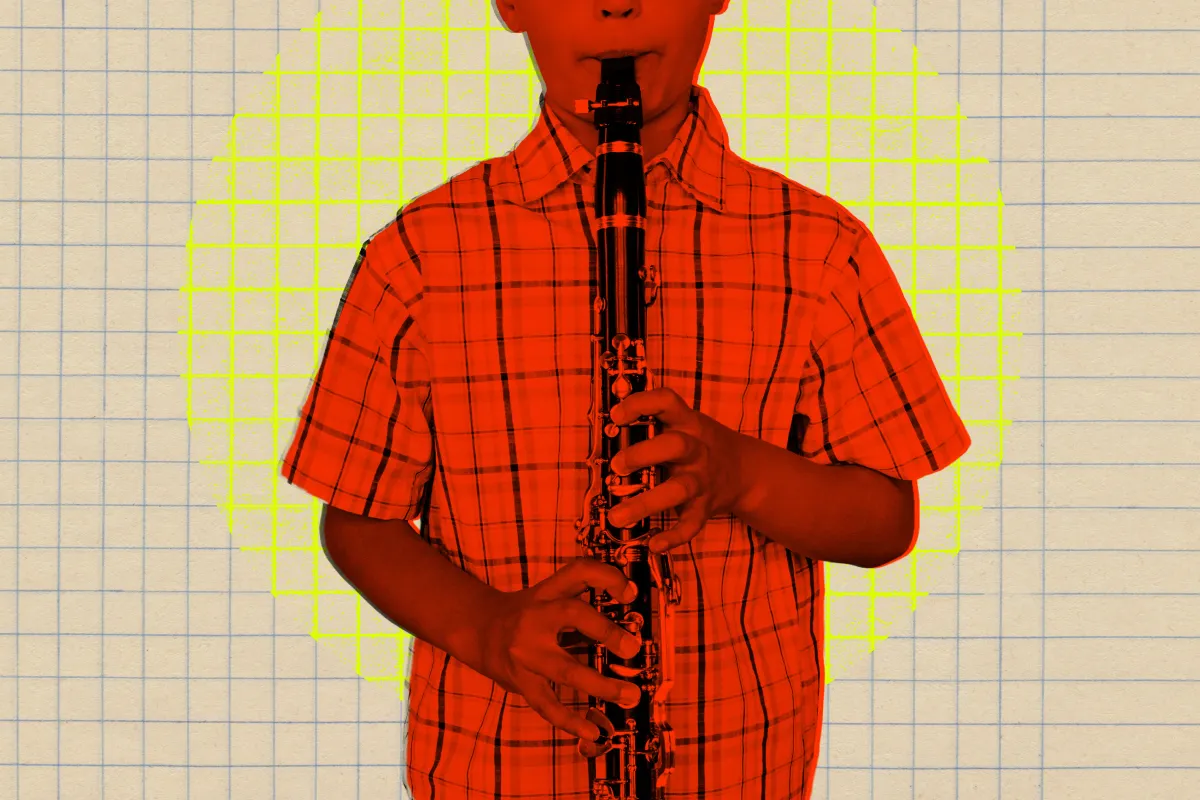

El problema es que la “arma” era en realidad un clarinete.

La situación se desarrolló rápidamente, de acuerdo con reportes locales. Cuando se emitió la alerta, se activó un “código rojo”, dejando a los administradores sin otra opción que reaccionar conforme a la decisión del sistema AI.

Afortunadamente, nadie resultó herido, y la policía local pronto declaró que el estado de alerta había terminado. “El código rojo fue una precaución y los niños nunca estuvieron en peligro”, escribió la policía local en un post de Facebook.

En un mensaje a los padres, la directora de la escuela, Dra. Melissa Laudani, mencionó que el distrito tiene “múltiples capas de seguridad escolar, incluyendo un sistema automatizado que detecta amenazas potenciales. Un estudiante estaba caminando por el pasillo, sosteniendo un instrumento musical como si fuera un arma, lo que activó el código rojo.” (No se sabe exactamente qué constituye un “código rojo”, ya que no se menciona en el último manual para padres y estudiantes de la escuela.)

En lugar de responsabilizar al sistema AI defectuoso por la confusión —sin el cual el fiasco no habría ocurrido— la escuela culpó al joven clarinetista.

“Aunque no hubo ninguna amenaza en el campus, me gustaría pedirles que hablen con su hijo sobre los peligros de fingir tener un arma en el campus escolar”, escribió Laudani.

No se sabe qué sistema tiene Lawton Chiles supervisando, pero el hecho de que no pueda diferenciar entre un clarinete con 17 llaves y un rifle sin ninguna es preocupante.

El incidente de Lawton Chiles ocurre poco después de otro caso similar, en el que un sistema AI condujo a la violenta detención de un adolescente de 16 años en Baltimore por al menos ocho oficiales con armas desenfundadas. En ese caso, el AI de la escuela había confundido un pequeño paquete de Doritos con un arma, provocando una respuesta armada de la policía de la ciudad.

Al igual que la historia de Lawton Chiles, el falso positivo de Baltimore podría haberse evitado fácilmente si hubiera habido un ser humano involucrado. En cambio, parece que ambos sistemas permitieron que el AI tomara la decisión sin ninguna oposición de un ser humano.

Omniilert, la compañía detrás del incidente de los Doritos, insistió en que su sistema AI “funcionó como se esperaba: priorizando la seguridad y la conciencia a través de una rápida verificación humana.”

Todo esto resalta la importancia de que estos sistemas de vigilancia AI en las escuelas funcionen correctamente antes de ser implementados —porque, cuando se trata de identificar a estudiantes con armas, los falsos positivos pueden ser tan mortales como los falsos negativos.

Más sobre vigilancia: Las personas comunes se están levantando en contra de las cámaras de vigilancia AI

—

Si necesitas algo más, ¡házmelo saber!

Con información de https://futurism.com/future-society/ai-surveillance-school-clarinet