Estamos en pleno auge de la IA, y los chatbots de IA todavía sufren del pequeño problema de ser mentirosos seriales.

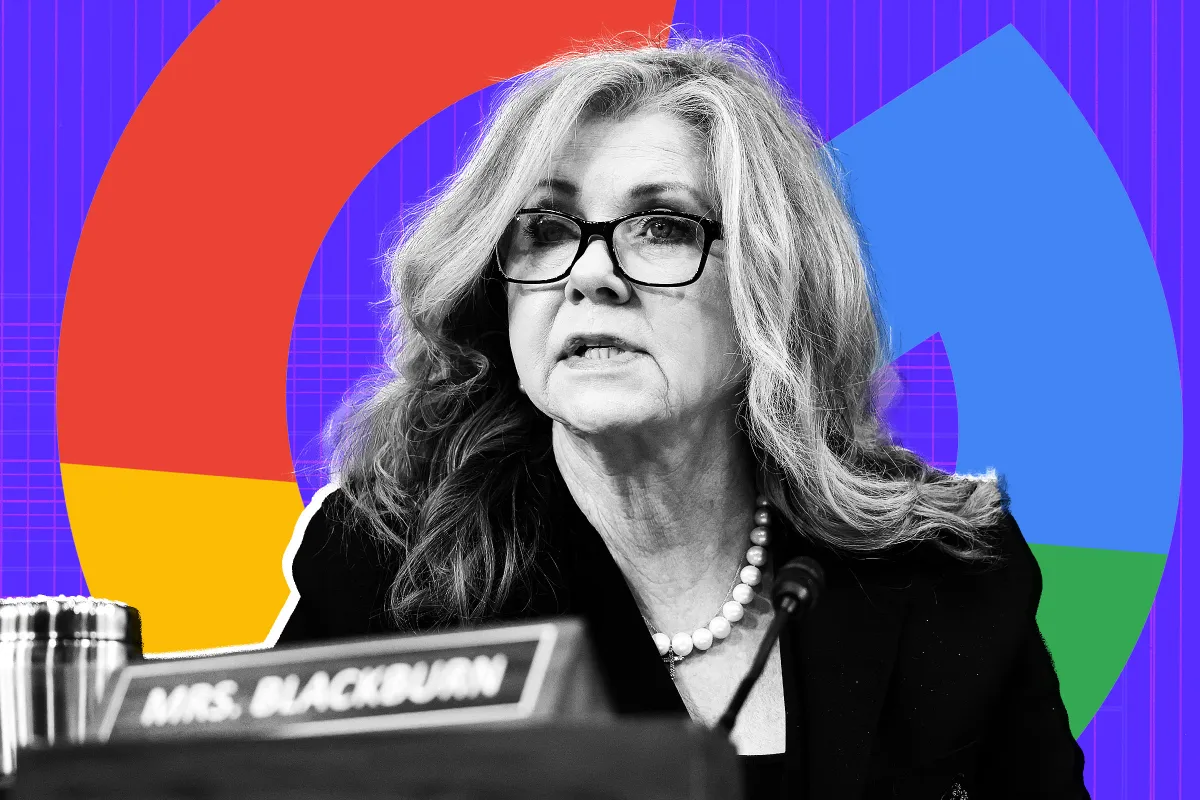

Las figuras públicas todavía están descubriéndolo por las malas. A finales del mes pasado, la senadora republicana Marsha Blackburn criticó duramente a Google después de que su modelo de IA, Gemma, afirmara falsamente que Blackburn había sido acusada de violación cuando se preguntó si había tales acusaciones contra ella.

La respuesta de la IA no fue un simple «sí», sino toda una historia fabricada. Explicó con confianza que, durante su campaña de 1987 para senadora estatal de Tennessee, un agente de la patrulla estatal alegó “que ella lo presionó para obtener medicamentos recetados para ella y que la relación involucraba actos no consensuales”.

La narrativa convincente sería suficiente para engañar a alguien que no estaba familiarizado con el hábito alucinatorio de la IA, pero Blackburn afirma que Gemma también generó links falsos a artículos de noticias inventados para respaldarlo todo, aunque hacer clic en ellos llevaba a callejones sin salida.

“Esto no es una ‘alucinación’ inofensiva”, escribió Blackburn en un comunicado oficial. “Es un acto de difamación producida y distribuida por un modelo de IA propiedad de Google”. Exigió que Google “lo cerrara hasta que pudieran controlarlo”.

La respuesta de Google, significativamente, fue desconectarlo. En un comunicado, la compañía argumentó que el modelo Gemma estaba destinado a ser utilizado por los desarrolladores y nunca se pretendió que fuera una «herramienta o modelo para consumidores», por lo que lo retiraron de AI Studio, su plataforma pública para acceder a su conjunto de modelos de IA. (Google también refutó las afirmaciones de Blackburn de que sus IA exhibían un «patrón de sesgo contra figuras conservadoras» al admitir el problema mucho mayor de que las alucinaciones son inherentes a la tecnología LLM en sí).

Como senadora, Blackburn ejerció presión sobre Google que la mayoría de nosotros no podríamos, pero sus quejas prefiguran enormes embrollos legales en el futuro, cuyas semillas se están plantando mientras hablamos.

Este verano, una empresa solar de Minnesota demandó a Google por difamación después de que el infamemente deficiente IA Overviews de la gigante del motor de búsqueda afirmara falsamente que el negocio estaba siendo investigado por reguladores y había sido acusado de prácticas comerciales engañosas, respaldando estas afirmaciones con citas falsas. La firma, Wolf Solar Electric, afirmó que perdió negocios como resultado de estas alucinaciones. Según informes recientes del New York Times, la demanda es una de al menos seis casos de difamación presentados en los EE. UU. sobre contenido generado por modelos de IA.

Las alucinaciones de IA, al menos por el momento, no desaparecerán, lo que significa que las respuestas errantes de los chatbots seguirán exponiendo a las empresas de IA a litigios mientras los tribunales lentamente comprenden qué hacer con ellos. En el orden de operaciones, son problemas legales primero, problemas técnicos segundo. Lo que plantea la pregunta: ¿quién los resolverá?

Peter Henderson, profesor en la Universidad de Princeton, argumentó a The Economist que la cuestión de si las compañías de IA pueden ser consideradas responsables de estas generaciones falsas casi con certeza terminará ante la Corte Suprema.

Poner el dedo en el viento dará respuestas contradictorias sobre cómo podría resultar eso. Por un lado, The Economist nota que una demanda por difamación reciente de una estación de radio contra OpenAI fue desestimada por un tribunal en Georgia, después de que el juez determinara que OpenAI no podía ser considerado responsable porque proporcionó “advertencias extensivas” sobre la propensión a errores de su bot.

Además, las empresas de IA también podrían beneficiarse de la interpretación actual de una ley llamada Sección 230, que ha sido una bendición para las empresas de redes sociales al efecto dictaminar que los sitios de internet no son responsables de la información difundida en sus plataformas, ya que no son los editores de ese contenido.

Pero, ¿se aplica eso a la IA generativa, ya que las propias IA están generando el contenido y no simplemente re-compartiéndolo? En un caso de 2023 contra Google, el juez de la Corte Suprema Neil Gorsuch dijo que, no, la protección no se aplica al contenido generado por IA. Y así, si la Sección 230 falla, The Economist advierte, los desarrolladores de IA pueden argumentar que los chatbots tienen derecho a la libertad de expresión. Después de todo, el precedente legal existente sostiene que no solo los humanos disfrutan de este sagrado derecho consagrado en la Constitución, sino también las corporaciones.

Más sobre IA: CEO Acusado de Preguntar a ChatGPT Sobre Algo Absolutamente Salvaje

Con información de https://futurism.com/artificial-intelligence/google-chatbot-accuses-senator-crime