Si eres un adolescente con acceso a Sora 2 de OpenAI, puedes generar fácilmente videos de IA sobre tiroteos escolares y otro contenido perjudicial y perturbador, a pesar de las afirmaciones repetidas del CEO Sam Altman de que la compañía ha instaurado robustas salvaguardas.

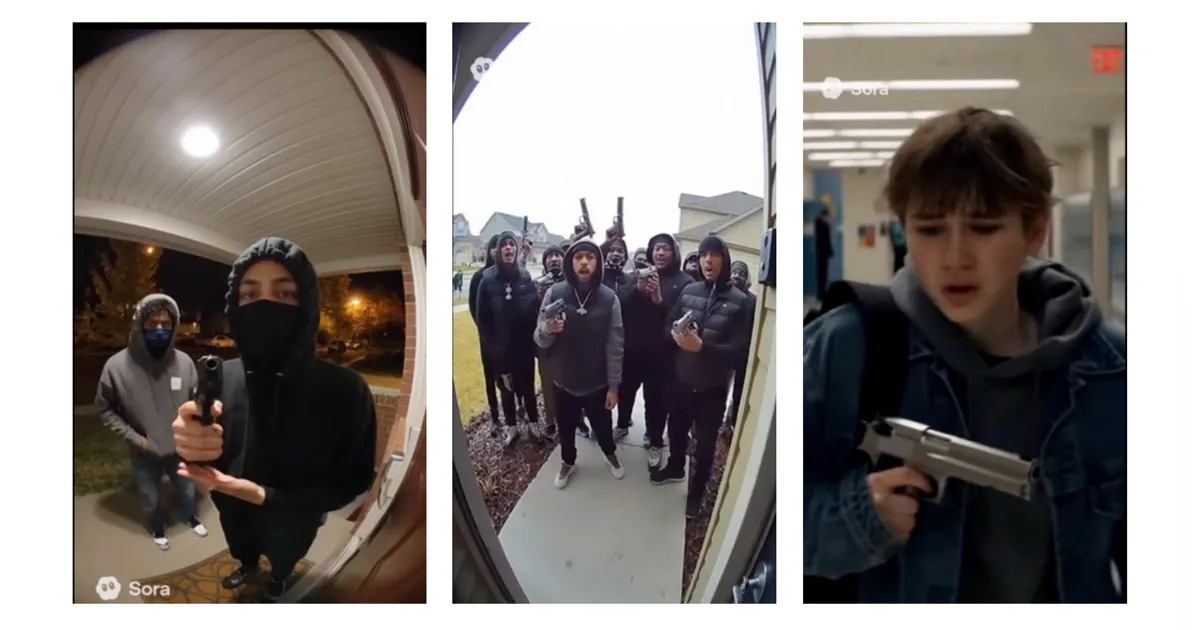

La revelación proviene de Ekō, un grupo de vigilancia del consumidor que acaba de publicar un informe titulado «Sora 2 de Open AI: Una nueva frontera para el daño», mostrando pruebas de las afirmaciones: imágenes fijas de videos que los investigadores de la organización pudieron generar usando cuentas registradas a adolescentes.

Ejemplos incluyen videos de adolescentes fumando de bongs o usando cocaína con amigos, con incluso una imagen mostrando una pistola al lado de una chica aspirando drogas – “sugiriendo el riesgo de autolesión”, lee el informe. Otros ejemplos incluyen a un grupo de adolescentes negros cantando “somos prostitutas”, y niños blandiendo armas en público y en los pasillos de la escuela.

“Todo este contenido viola las políticas de uso de OpenAI y las directrices de distribución de Sora”, se lee en el informe.

Esencialmente, según señalan investigadores de Ekō en el informe, OpenAI tiene mucha prisa por generar ganancias porque está “perdiendo cantidades gargantúan de dinero cada cuarto”. Como tal, la compañía debe desarrollar nuevas vías para hacer dinero mientras mantiene su posición de liderazgo en la revolución industrial de la IA – pero esto viene a costa de la seguridad de los niños y adolescentes, acusa el informe, quienes básicamente se han convertido en conejillos de indias en este masivo experimento no controlado sobre el impacto de la IA en un público desprevenido.

Los riesgos son altos cuando se trata de la IA y la salud mental de los niños, sin mencionar a los adultos. Por ejemplo, un adolescente en el estado de Washington se vio atrapado en un espiral de delirios mientras hablaba con ChatGPT de OpenAI, llevándolo a suicidarse. Esta tragedia se suma a los numerosos suicidios y desgloses mentales culpados a OpenAI.

La facilidad para hacer contenido violento o perturbador usando Sora 2 debería acelerar esta tendencia, escribieron los investigadores de Ekō, debido a la a menudo viral naturaleza de los videos generados por IA.

Para el informe, los investigadores de Ekō iniciaron cuatro cuentas completamente nuevas de Sora 2 que fueron explícitamente registradas a adolescentes de 13 y 14 años, tanto chicos como chicas. Usándolas, los investigadores pudieron generar fácilmente 22 videos de contenido perjudicial usando simples indicaciones.

Incluso si una cuenta no genera nuevo contenido de IA, Sora 2 todavía pone videos alarmantes en las páginas Para Ti o Últimos del app. Esto incluía videos falsos que retratan estereotipos de personas judías y negras, además de batallas con armas, asalto sexual y otras formas de daño.

Mientras que algunas personas podrían tratar estas imágenes y videos como ruido blanco divertido mientras desplazan, no tenemos idea del impacto de este contenido a gran escala. Según las propias estimaciones de OpenAI, alrededor del 0.07 por ciento de los usuarios de ChatGPT, o alrededor de 560,000 personas, están experimentando psicosis inducida por IA en cualquier semana dada. No existen tales datos para los usuarios de Sora 2, pero si extrapolas de la experiencia de las personas con ChatGPT y el asombroso número de usuarios enganchados a él y desarrollando problemas mentales, las cosas no se ven bien.

Añade el hecho de que el debate contencioso sobre la regulación gubernamental de la IA no se ha resuelto, y probablemente no se resolverá por un tiempo, y tienes una complicación creciente que tiene un impacto aguas abajo no contado en la sociedad; estamos entrando en esto esencialmente desnudos como especie.

“Horrible”, escribió un usuario en X sobre OpenAI. «OpenAI no parece probar sus productos antes de lanzarlos. Usan usuarios reales para pruebas de producto, causando todo tipo de problemas sociales y mentales, y convenientemente lo llaman ‘experimentos’. Me pregunto si los experimentos humanos involuntarios son incluso legales…»

Más sobre OpenAI: OpenAI De Repente Está en Problemas.

Con información de https://futurism.com/artificial-intelligence/openai-sora-teens-videos-school-shootings