Aunque la plataforma de juegos infantiles Roblox ha llegado a tener más de 200 millones de usuarios diarios en su punto máximo, no todos están allí solo por diversión y juegos. Activa desde 2006, este extremadamente popular juego en línea se ha convertido en un refugio para actores malintencionados, como estafadores que manejan casinos en línea para usuarios menores de edad o pedófilos en busca de víctimas.

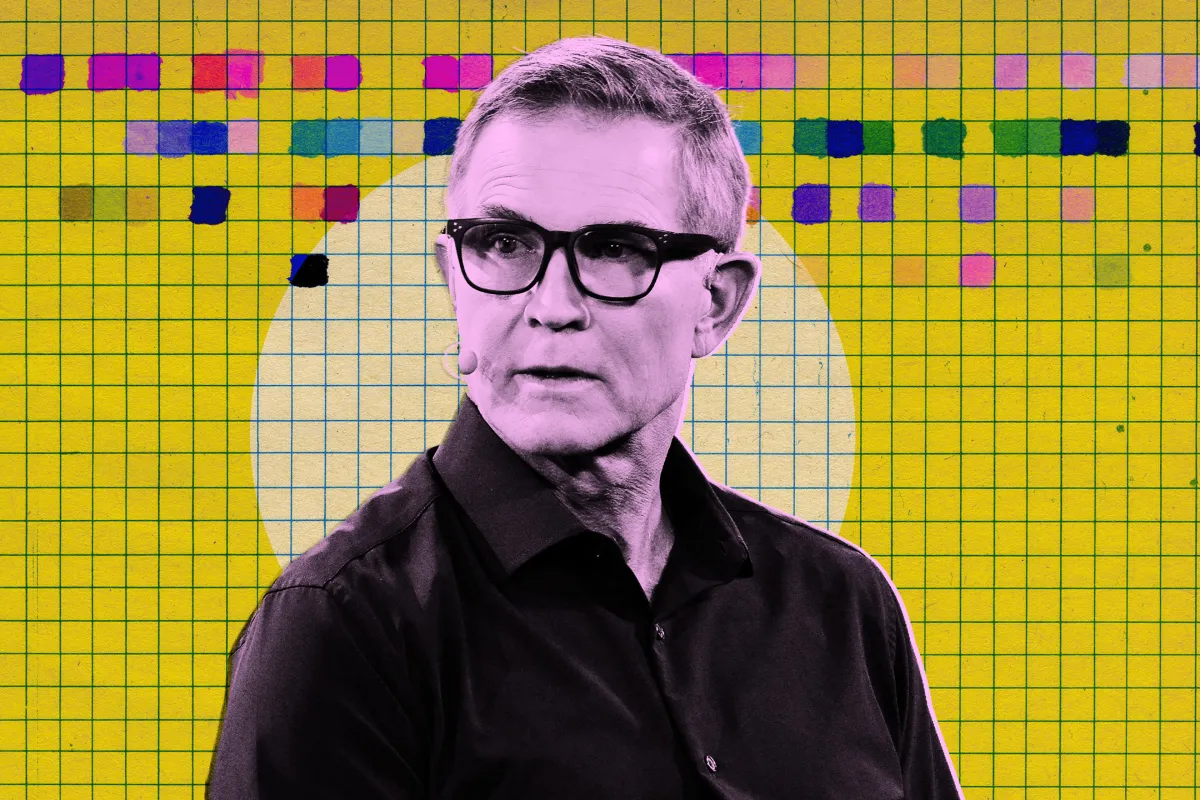

Es un problema del cual Roblox ha sido plenamente consciente, ya que 20 demandas federales contra la compañía han llevado la seguridad de los niños en la plataforma a la atención nacional. En respuesta a la intensa reacción, la compañía ha implementado un sistema de reconocimiento facial diseñado para agrupar a usuarios de edades similares entre sí. Ese sistema abre otro tipo de problemas, pero ahora son los comentarios hechos por el CEO y cofundador de Roblox, David Baszucki, los que están causando mayor inquietud.

En una extensa nueva entrevista en el podcast “Hard Fork» del New York Times, Baszucki no minimizó el problema de la explotación infantil como algunos podrían esperar. En su lugar, desconcertantemente lo enmarcó como una “oportunidad».

Preguntado por el co-anfitrión Casey Newton sobre cómo ve el problema de los depredadores infantiles en su plataforma, el CEO de Roblox dijo que el problema no era solo un “problema, sino también una oportunidad».

“¿Cómo permitimos que los jóvenes construyan, comuniquen y pasen tiempo juntos? ¿Cómo construimos el futuro de la comunicación al mismo tiempo? Así que, ya sabes, hemos estado trabajando en esto de buena manera desde que empezamos… y así, avanzando rápido hacia donde estamos hoy, es solo como cada semana, ¿cuál es la última tecnología? A la escala en la que estamos, 150 millones de activos diarios, 11 mil millones de horas al mes, ¿cuál es la mejor manera de seguir avanzando esto?»

Más tarde, cuando los anfitriones preguntaron a Baszucki sobre los desafíos de manejar la seguridad de los usuarios en una escala astronómica, el CEO presentó nuevamente el problema como una oportunidad de negocio, específicamente, una oportunidad para tallar un monopolio en la escena de los juegos en línea.

“Creo que realmente vemos que hay una oportunidad increíble”, respondió Baszucki. “Como, el espacio de los juegos, de alguna manera, es de 190 mil millones de dólares. Así que, ahora tenemos alrededor de tres o cuatro por ciento de eso – supongo que tres por ciento – pasando por Roblox. Así que diría que nos gusta la escala: crea una oportunidad para los creadores de juegos individuales que podrían estar haciendo su juego por sí mismos, sin ser parte de sistemas como ese, para hacerlo como parte de un sistema más general.”

Ese «sistema más general», por supuesto, es Roblox, con todas sus características de chat incorporadas y la históricamente pobre moderación de usuarios.

Los anfitriones de Hard Fork continuaron interrogando a Baszucki sobre un informe de 2024 por el vendedor en corto y firma activista Hindenburg Research, titulado “Roblox: Métricas Clave Infladas para Wall Street y un Paisaje Infernal de Pedófilos para Niños”. Como detalla el título colorido, la tesis del informe era que Roblox estaba reduciendo su gasto en seguridad de los usuarios para informar crecimiento a los inversores.

“Primero que todo, Hindenburg ya no existe, ¿correcto? Así que, deberían informar sobre eso”, esquivó Baszucki, haciendo referencia al cierre voluntario de la firma a principios de este año. “Por alguna razón, cerraron sus operaciones.”

“Es realmente interesante, porque creo que nos estamos adentrando en una situación donde estamos mejorando, mejorando, mejorando”, continuó el CEO de Roblox. “Pero, ¿harías la misma pregunta a alguien que pasó de quizás un trabajo manual hiperintensivo haciendo autos a mano a una línea de ensamblaje?”

En otras palabras, Baszucki afirma que la razón de la disminución en el gasto en seguridad está directamente vinculada con la adopción de sistemas de IA. Uno de esos sistemas de moderación, anunciado durante el verano, supuestamente estaba diseñado para detectar “señales tempranas” de peligro para los niños. Sin embargo, bajo las publicaciones en redes sociales de Baszucki sobre la herramienta, puedes encontrar docenas de quejas de que la IA está fallando en detener contenido dañino.

“MeepCity [un juego en Roblox]… ha visto cantidades extremas de contenido inapropiado durante años”, advirtió un usuario. “Parece que nunca se ha tomado una acción efectiva para detener el comportamiento violatorio. ¿Es la moderación por IA incapaz de detectar este tipo de contenido o se está permitiendo?”

Es demasiado pronto para decir si el nuevo software de reconocimiento facial será suficiente para detener a los depredadores sexuales de abusar de la plataforma, pero considerando la larga historia de Roblox de soluciones ineficaces, sin mencionar la salida combativa de su CEO en Hard Fork, no estamos conteniendo la respiración.

Más sobre moderación de contenido: Si ya pensabas que Facebook era tóxico, ahora está reemplazando a sus moderadores humanos con IA.

Con información de https://futurism.com/artificial-intelligence/roblox-ceo-predators