Aquí tienes una versión traducida y reescrita del contenido:

—

El 11 de diciembre, OpenAI lanzó ChatGPT 5.2, la última versión de su popular chatbot de inteligencia artificial.

Como suele hacer con cada actualización menor, la empresa celebró su nueva versión como una “mejora significativa en la inteligencia general,” describiéndola como el “mejor modelo hasta ahora para uso profesional en el mundo real.” En un alarde de confianza, OpenAI incluso afirmó que 5.2 es su “primer modelo que funciona a un nivel igual o superior al de un experto humano.”

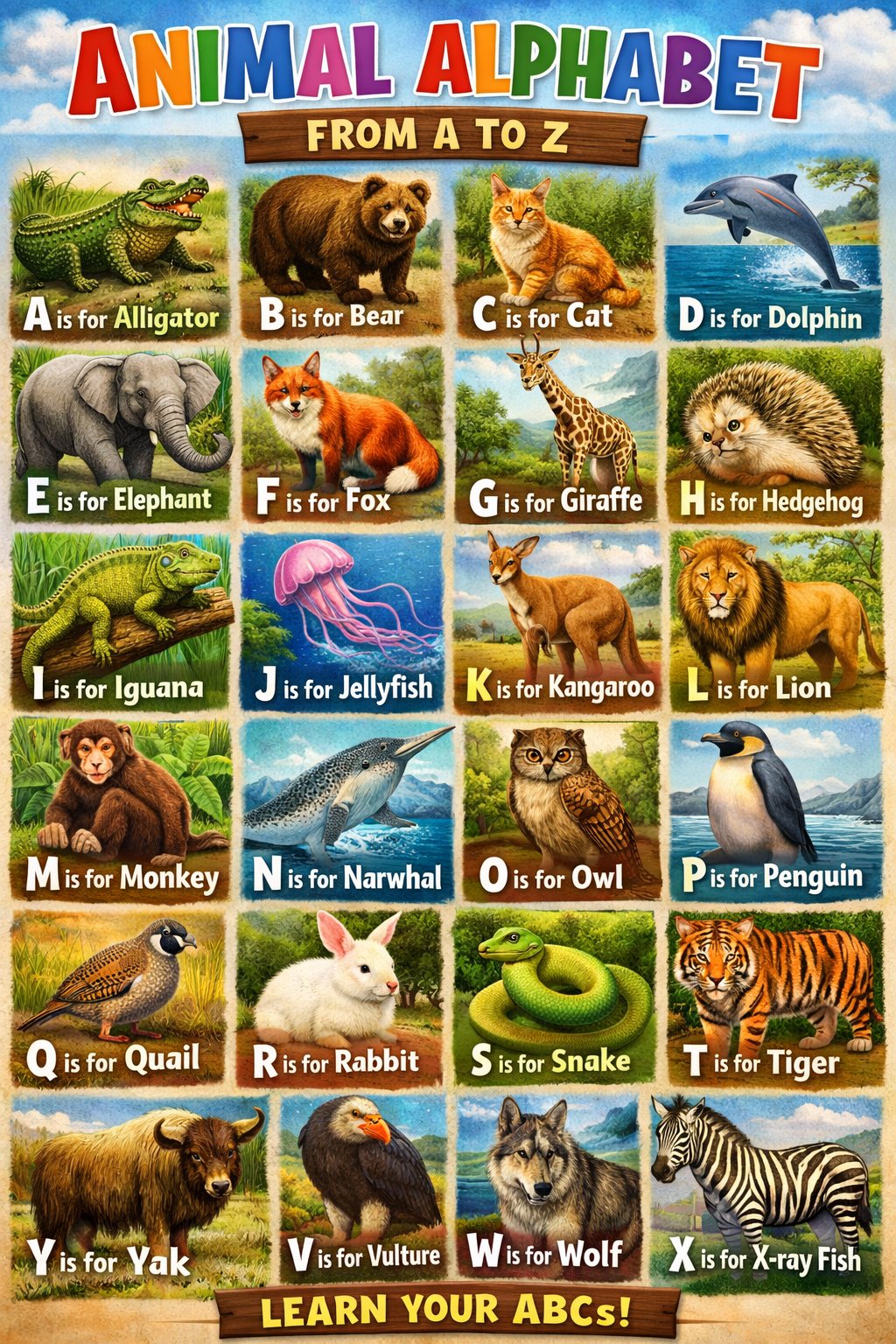

Sin embargo, al probarlo con un simple prompt —generar un cartel de animales en orden alfabético para niños— el modelo de IA resultó ser bastante deficiente.

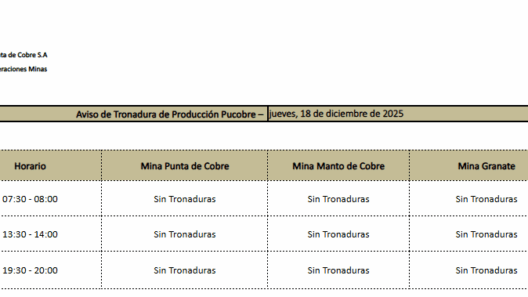

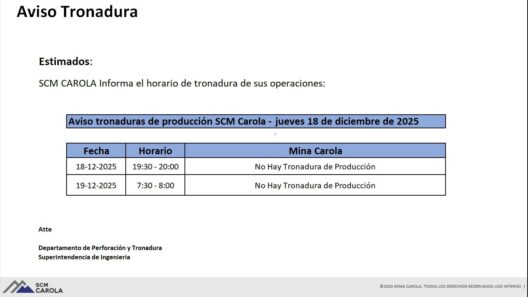

La falta de precisión en el abecedario fue inicialmente observada por Peter Berezin, estratega global jefe de BCA Research. Usando ChatGPT 5.1, que se lanzó en noviembre, Berezin pidió a la IA que “dibujara un cartel donde dijera que A es para un animal que comienza con la letra A, B es para un animal que comienza con B, y así hasta Z.”

Esa versión tardó seis segundos en pensar y generó una imagen con 25 letras, en lugar de las 26 correspondientes al alfabeto inglés. Comenzando con un mal pie, 5.1 hizo un trabajo aceptable con las letras “A” a “I,” pero se equivocó con la “K,” afirmando que “es para León.”

Prosiguió así: “O es para medusa,” mientras que “Q es para pingüino” y “R es para serpiente.” Al llegar al final, “Z” es para “urba” —una tortuga, al parecer— seguido de “B,” con una imagen de un cerdo.

“Aún necesita más inversión,” bromea Berezin, refiriéndose a los $1.15 billones que OpenAI se ha comprometido a gastar en hardware solo en 2025.

Teníamos curiosidad por saber cómo se comparaba ChatGPT 5.2 con su predecesor de hace un mes; y efectivamente, no defraudó.

Aunque la última versión hizo un poco mejor con los animales individuales, solo identificó 24 letras en el alfabeto inglés, olvidando las letras “U” y “Z.” En su lugar, 5.2 enlistó “Y” para “Yak” justo después de “T.” Este abecedario termina con “X,” que por supuesto representa “pez radiactivo,” pero ilustrado con una cebra.

Sus ilustraciones también fueron algo cuestionables, con canguros con miembros raros, una iguana con dos colas, un narval con una extraña mezcla de ojos y aletas además de un pico de ave, y un erizo con cara de gato, por nombrar algunos puntos débiles.

Un prompt de seguimiento solo extendió el desastre. Esta vez, hay 25 letras en total. La “Y” sigue siendo problemática, reemplazando la “U,” solo que esta vez significa “Unicornio,” que no es un animal real. Al final, hay dos entradas para “X,” una de las cuales “es para pez,” seguida de otro “X,” nuevamente para “pez radiactivo,” pero con la misma ilustración de cebra.

El segundo cartel también comienza a mezclar las instrucciones, inyectando partes del prompt en el título del cartel: “A es para caimán, B es para oso…”

Como algunos usuarios de X, anteriormente conocido como Twitter, señalaron, los resultados son similares para Gemini de Google, y como un rápido vistazo a Grok demuestra, el motor de IA de Elon Musk ni siquiera está cerca. Pero aunque ChatGPT puede ser el mejor en hacer un cartel de animales, aún se queda corto —y ciertamente no al nivel de ningún “experto humano” que hayamos conocido.

Más sobre ChatGPT: El lado oscuro de ChatGPT ha provocado una ola de suicidios, dicen familias en duelo

—

Si necesitas más modificaciones o un enfoque diferente, ¡házmelo saber!

Con información de https://futurism.com/artificial-intelligence/chatgpt-openai-alphabet-animals