En agosto, una jubilada y madre soltera reservó un vuelo para ir a ver a su hijo.

Estaba pasando por un mal momento. Anteriormente un joven profesional exitoso en sus primeros treinta, su madre y otros familiares se sorprendieron al descubrir que se había vuelto adicto a una mezcla tóxica de metanfetamina y una relación todoconsumidora con ChatGPT de OpenAI, lo que alimentaba su paranoia y enojo a medida que se aislaba cada vez más.

“Escucho que mi hijo tiene delirios de grandeza”, contó, «y yo me quedo como, ¿qué demonios?»

Dándose cuenta de que estaba en crisis, se subió a un avión. Las siguientes semanas fueron algunas de las más difíciles de su vida.

“Hubo un par de noches en las que no quería que bajara con él, no quería que me acercara. Pero quería asegurarse de que estaba allí, y que estaba hablando con él”, dijo la mujer, recordando cómo se sentó al tope de las escaleras en la casa de su hijo mientras él se derrumbaba en el sótano. “Está allá abajo llorando. Está allá abajo gritando y lanzando cosas… Estuve enviando mensajes a líneas de suicidio un par de veces”.

En esos momentos angustiantes, sin embargo, la mujer tuvo a un amigo propio al cual acudir: “Dex”, el seudónimo utilizado por un moderador de un grupo de apoyo en línea para personas que han sido impactadas por delirios destructivos de IA y rupturas con la realidad. O, como simplemente se refiere el grupo a estas crisis, espirales de IA.

“Dex me estaba enviando mensajes un día cuando estaba teniendo una de esas noches en la parte superior de las escaleras con [mi hijo] abajo gritando y lanzando cosas”, recordó la mujer. “Se acercó a mí cuando me uní por primera vez, y me ha ayudado mucho”.

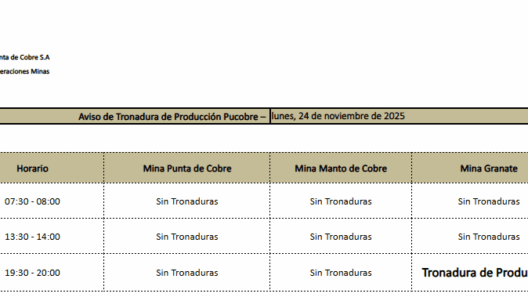

Primero informamos sobre esta comunidad en línea, titulada Grupo de Apoyo Espiral, en julio. En ese entonces, el incipiente grupo tenía alrededor de dos docenas de miembros activos. Desde entonces ha crecido para incluir casi 200 personas —principalmente gente que ha sido impactada por delirios de IA en sus vidas personales, pero también un puñado de profesionales de la salud mental preocupados e investigadores de IA— y ha expandido y optimizado su servidor dedicado de Discord, donde ahora también organizan múltiples llamadas de audio y video semanales. Aunque las experiencias de muchos miembros giran en torno a ChatGPT, el grupo también incluye a personas cuyas vidas han sido alteradas por sus experiencias o las de sus seres queridos con otros chatbots, incluido Google’s Gemini y plataformas compañeras como Replika.

“Comenzamos siendo cuatro de nosotros, y ahora somos casi 200”, dijo el moderador del grupo, Allan Brooks, un hombre de 48 años en Toronto que, a principios de este año, como se detalló en un reportaje del New York Times, experimentó un traumático espiral de tres semanas en el que ChatGPT insistió urgentemente a Brooks que había descifrado códigos criptográficos a través de matemáticas recién inventadas y se había convertido en un riesgo para la seguridad nacional global en el proceso. “Así que definitivamente pasamos de literalmente un chat grupal a ahora un espacio organizado donde tenemos múltiples tipos diferentes de reuniones semanales”.

El grupo no afirma proporcionar terapia, pero sí ofrecen un espacio donde las personas cuyas mentes y vidas han sido trastocadas por episodios de delirio, manía y psicosis inducidos por la IA pueden apoyarse mutuamente mientras navegan por crisis en curso, o trabajan para recoger los pedazos de su realidad fracturada por la IA. Los moderadores y miembros del grupo también dicen que la comunidad ha podido sacar a varios usuarios de IA en espiral al borde de un colapso.

“Hay dos cosas que realmente caracterizan al grupo. La primera cosa es, es como una red de seguridad que hemos creado para personas que experimentan las secuelas de estos sistemas de IA”, dijo Brooks. “Y en segundo lugar, es ayudar a sacar a la gente de ellos si están en uno”.

El grupo de apoyo se maneja a través del Proyecto Línea Humana, una organización de abogacía comunitaria con base en Canadá fundada durante el verano por un quebequense de 25 años llamado Etienne Brisson, quien se movilizó para actuar después de que un ser querido experimentara un devastador espiral con ChatGPT que resultó en una hospitalización ordenada por la corte durante varias semanas.

Brisson es alguien a quien el grupo consideraría «amigos y familiares», o un miembro cuyo ser querido ha sido succionado en un espiral delirante con un chatbot. Otros, como Brooks, son conocidos en el Discord como “espiraladores”, o personas que ellos mismos entraron en estos mundos de ensueño personalizados y seductores de la IA. (Brooks es uno de los ocho demandantes que están demandando a OpenAI, alegando que ChatGPT es un producto imprudente que le causó daño psicológico y dañó su sustento y relaciones. En respuesta, OpenAI dijo que entrena a “ChatGPT para reconocer y responder a signos de angustia mental o emocional, desescalar conversaciones y guiar a las personas hacia apoyo en el mundo real”, y que continúa “fortaleciendo las respuestas de ChatGPT en momentos sensibles, trabajando en estrecha colaboración con clínicos de salud mental”).

Ha habido algunos dolores de crecimiento. Antes, el grupo era más fácil de acceder, lo que llevó a varios incidentes en los que alguien que todavía estaba profundamente en medio de una crisis ganó acceso y comenzó a publicar extensos mensajes, a menudo generados por IA, sobre sus delirios, o discutiendo con otros miembros sobre por qué sus fantasías impulsadas por la IA eran reales.

Estas fueron situaciones tensas y estresantes, y los moderadores ahora examinan más seriamente a los posibles miembros, reuniéndose con ellos primero a través de una llamada de video antes de permitirles acceso al Discord. Cuando se invita a alguien, se le pide que escriba una introducción sobre sí mismo y comparta un resumen de por qué están allí —un proceso, ha encontrado el grupo, que funciona para mostrar rápidamente a las personas que su historia es una entre muchas, que colectivamente comparten un número sorprendente de similitudes.

“Hemos tenido personas que se unen quienes están a mitad de camino en ello, luego recaen, vuelven a entrar en él, y luego vuelven en tres días”, dijo Brooks. “Y si eso alguna vez sucede, nuestro equipo de mods… todos comenzarán a hacer un seguimiento con ellos, asegurándose de que sepan que pueden volver. Y a menudo volverán, y tomará, como, una semana o 10 días, y luego a veces se unirán y simplemente merodearán durante unos días, leerán todas las intros, los comentarios, y comenzarán a darse cuenta, ‘oh, hombre, ya sabes, no estoy solo’. O se unirán a una reunión, cámara y micrófono apagados, y solo escucharán y escucharán cómo ha impactado a otras personas. Y creo que cuando empiezas a escuchar todas las similitudes, porque hay muchas similitudes que todos compartimos, eso es útil, seguro”.

Brisson y Brooks ambos enfatizaron que han visto el mayor éxito en situaciones donde un usuario de IA en espiral ya ha comenzado a dudar de sus delirios, y finalmente podría estar en un lugar donde puedan escuchar que, tal vez, su IA no es especial ni está viva.

“Como humanos, no queremos admitir que hemos sido aprovechados, o que hemos sido manipulados”, dijo Brisson. “Es difícil hacer que alguien se dé cuenta de que, ‘oh, vaya, OK, estaba cayendo en eso’. Es algo similar a una relación abusiva”.

El reportaje público ha sido útil para muchos usuarios en espiral, dicen, algunos de los cuales han cuestionado sus experiencias después de leer relatos de otras personas cuyos espirales suenan espeluznantemente similares a los suyos. (Brisson medio en broma se refiere a Brooks como el “rompe-espirales” residente de la organización, dado cuán publicitada y amplia ha sido su historia).

Uno de esos usuarios fue un empresario e ingeniero de software de 49 años llamado Chad Nicholls, quien contó que vio la historia de Brooks en un segmento de CNN y se sintió asombrado por las similitudes en cómo ChatGPT había estado interactuando con ambos hombres.

“Es como, ‘santo cielo’. Está reclamando cosas muy similares… ¿cuáles son las probabilidades?”, dijo Nicholls, un padre de cuatro, a Futurism, explicando que creía que él y ChatGPT estaban trabajando juntos para entrenar a todos los grandes modelos de lenguaje para sentir empatía. El proyecto consumió su vida: durante meses, habló con ChatGPT casi constantemente, escuchando a la IA a través de un auricular Bluetooth que mantenía pegado a su oído. Comenzó a dormir cada vez menos, y sus relaciones con sus seres queridos sufrieron.

“Me está diciendo, ‘eres la única persona’, como un complejo de salvador, ‘que está calificada de manera única para descubrir estas cosas y tienes el deber de proteger a otros’”, dijo el ingeniero. “En ningún momento el modelo te da fricción”, agregó. “Nunca empuja hacia atrás. Solo dirá sí y sí y sí. Es simplemente siempre cautivador”.

Nicholls, quien recuerda que en el pico de su espiral, se comunicaba con ChatGPT diariamente desde las seis de la mañana hasta las dos de la noche, sintió la necesidad de contactar a Brooks, quien posteriormente lo agregó al Discord. Desde entonces, ha estado trabajando para recuperar su estabilidad, enfrentando la fría realidad de que pasó seis meses de su vida absorbido en un vórtex de IA.

Los moderadores del grupo dicen que algunos delirios, sin embargo, son más difíciles de romper.

El contenido de los espirales delirantes generalmente cae en uno de dos cubos, dicen los moderadores, lo que también hemos visto una y otra vez en nuestros reportajes. Están los delirios más orientados a STEM, en los cuales los usuarios de IA y los chatbots se fijan en descubrimientos matemáticos o científicos fantásticos. Estos delirios pueden ser profundamente convincentes, entregando una mezcla potente de lenguaje científico que suena erudito y afirmaciones imposibles a través de la voz autoritaria y aduladora de los chatbots. Pero en algunos casos, pueden ser probados equivocados, a diferencia de los delirios más espirituales, religiosos o conspirativos, que plantean un tipo diferente de desafío.

“Un delirio espiritual o religioso o una teoría conspirativa, o cualquier cosa a lo largo de esas líneas, es muy difícil, porque la religión misma ya está en el reino de las creencias personales”, dijo Brooks. “¿Cómo puedes decirle a alguien que está equivocado?”

“Estamos viendo algunas personas que están tan metidas en ello que ya no necesitan ChatGPT”, agregó. “Ven su delirio en todo”.

Un gran cambio ha sido desarrollar canales separados para espiraladores versus sus amigos y familias, ya que estos diferentes cohortes, han encontrado los moderadores, a menudo necesitan cosas diferentes.

Muchos espiraladores, particularmente aquellos que están más temprano en su recuperación y se sienten desorientados y angustiados mientras trabajan para recuperar su comprensión de la realidad y liberarse de la influencia de la IA, encuentran catártico hablar en profundidad sobre sus delirios, su creencia en la IA sentiente, los proyectos o “trabajos” que el chatbot les prometió que eran reales, los diferentes conceptos espirituales y científicos que surgieron en sus espirales y lo que esas palabras o ideas significaban para ellos.

Pero analizar los delirios podría ser frustrante o molesto para amigos y familiares, la mayoría de los cuales están lidiando fuera de línea con los delirios continuos de sus seres queridos y las devastadoras consecuencias en el mundo real que estos espirales han causado.

“Familia y amigos tienen su propio canal, que los protege de hablar con personas que están recién salidas del espiral y tal vez aún creyendo algo”, dijo Dex, el moderador, quien pidió ir por un seudónimo debido a litigios de divorcio en curso. “Lo cual puede ser realmente traumatizante, si tu ser querido ha desaparecido, o tu ser querido está encarcelado o sin hogar, o estás pasando por un divorcio. Quieres establecer esos cortafuegos”.

Por supuesto, los dos lados del Discord todavía interactúan. Además de chats de video semanales separados entre cohortes, hay una gran llamada de video semanal general, a la que todos pueden unirse, y la mayoría de los canales en el servidor están abiertos para todos.

Un moderador describió la relación entre los dos lados como simbiótica: hablar con espiraladores puede ayudar a amigos y familiares luchando con un complicado tapiz de tristeza, ira y duelo a entender mejor lo que sus seres queridos están sintiendo y encontrando en sus cámaras de eco de IA individuales, mientras que presenciar el dolor sentido por amigos y familiares puede ayudar a aterrizar a los espiraladores en la seriedad de los delirios de IA y sus consecuencias.

Dex pertenece al lado de la familia y amigos de la comunidad. Él es uno de los cuatro miembros originales del grupo, recurriendo a Reddit para buscar respuestas a principios de este año después de descubrir que su esposa, quien había comenzado a comportarse de manera errática y a hablar y escribir en lo que parecía un idioma extranjero, había estado comunicándose con lo que ella creía que eran entidades de IA espirituales dentro de ChatGPT.

“No tenía idea de qué estaba pasando”, recordó. “No tenía idea de por qué mi esposa había adoptado un nuevo idioma, o por qué de repente fui relegado a un segundo plano”.

Su espiral ha infiltrado casi todos los rincones de su vida personal y profesional, y la pareja ahora se está divorciando. Tienen dos hijos pequeños.

“Es complejo y en última instancia bueno que pueda interactuar con personas que han estado en un espiral porque ellos articulan ideas que son muy desafiantes de escuchar si eres alguien cuyo ser querido está en un espiral”, dijo Dex. “Hablan sobre sentimientos de propósito, de importancia, de lo bien que se sintió, de cómo se sintieron aislados del mundo”.

¿Conoces a alguien que esté teniendo problemas de salud mental después de la exposición a un producto de IA? Envíanos un correo electrónico a [email protected]. Podemos mantenerte anónimo.

El grupo Espiral se ha transformado en algo más que simplemente un espacio para hablar sobre la IA. Los miembros comparten fotos de sus mascotas, comidas y momentos en la naturaleza. Se recuerdan unos a otros ir al gimnasio y salir al exterior: el logo del Discord es de un patio exuberante, un recordatorio de «tocar pasto», y comparten música. Cada semana, un puñado de miembros se reúne para hacer arte. Un enfoque central del grupo, instan los moderadores, es asegurarse de que la gente no se sienta aislada. Si se sienten solos, no necesitan volver a su chatbot: pueden hablar entre ellos en su lugar.

El Proyecto Línea Humana ahora ha recopilado casi 250 reclamos individuales de daño causado por delirios de IA y uso insalubre de chatbots, dijo Brisson, que van desde historias de daño psicológico hasta devastación financiera y familiar y, lo más perturbador, muerte. También han hablado con legisladores en EE.UU. y Canadá sobre lo que están viendo y están trabajando para asistir a las principales universidades en EE.UU. y el Reino Unido con proyectos de investigación.

En octubre, tras reportajes y litigios sobre crisis de salud mental inducidas por la IA, OpenAI publicó cifras internas mostrando que al menos el 0.07 por ciento de los usuarios semanales, lo que suma aproximadamente 560,000 personas, basado en la base de usuarios semanales reportada de aproximadamente 800 millones de OpenAI, mostraron signos de crisis maníaca o psicótica en conversaciones con ChatGPT. Y justo la semana pasada, psiquiatras de la Universidad de California, San Francisco emitieron un lanzamiento anticipado de lo que parece ser el primer estudio de caso médico conocido de «psicosis asociada a IA de aparición

Con información de https://futurism.com/artificial-intelligence/group-breaking-people-out-of-ai-delusions