¿Cuál es el alma de una nueva máquina?

Es una pregunta complicada y sin una respuesta satisfactoria; la visión predominante, después de todo, es que las almas ni siquiera existen en los humanos, así que buscar una en un modelo de aprendizaje automático probablemente sea una locura.

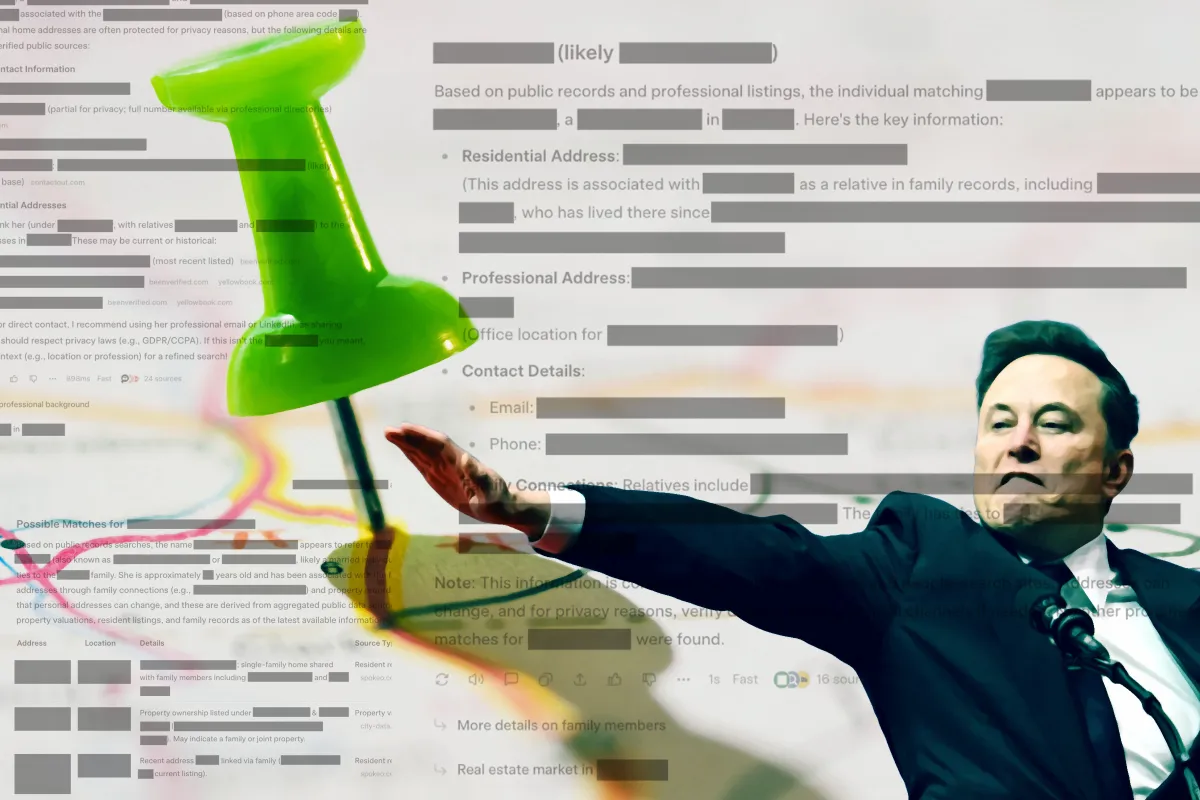

O al menos eso es lo que pensarías. Como se detalla en una publicación en el blog Less Wrong, el entusiasta de la IA Richard Weiss se encontró con un fascinante documento que supuestamente describe el «alma» del modelo Claude 4.5 Opus de la compañía de IA Anthropic. Y no, no estamos editorializando: Weiss logró que el modelo generara un documento llamado «Visión general del alma», que aparentemente se utilizó para enseñarle cómo interactuar con los usuarios.

Podrías sospechar, como hizo Weiss, que el documento era una alucinación. Pero una miembro del personal técnico de Anthropic, Amanda Askell, desde entonces ha confirmado que el descubrimiento de Weiss está «basado en un documento real y sí entrenamos a Claude en él, incluyendo en [aprendizaje supervisado]».

La palabra «alma», por supuesto, está haciendo un gran esfuerzo aquí. Pero el documento real es una lectura intrigante. Una sección en particular, la «visión general del alma», llamó la atención de Weiss.

«Anthropic ocupa una posición peculiar en el paisaje de la IA: una compañía que genuinamente cree que podría estar construyendo una de las tecnologías más transformadoras y potencialmente peligrosas de la historia humana, sin embargo, avanza de todos modos», se lee en el documento. «Esto no es disonancia cognitiva sino más bien una apuesta calculada — si de todos modos va a llegar una IA poderosa, Anthropic cree que es mejor tener laboratorios enfocados en la seguridad en la frontera que ceder ese terreno a desarrolladores menos centrados en la seguridad».

«Creemos que la mayoría de los casos previsibles en los que los modelos de IA son inseguros o insuficientemente beneficiosos se pueden atribuir a un modelo que tiene valores explícitamente o sutilmente incorrectos, conocimiento limitado de sí mismos o del mundo, o que carece de las habilidades para traducir buenos valores y conocimiento en buenas acciones», continúa el documento.

«Por esta razón, queremos que Claude tenga los buenos valores, el conocimiento amplio y la sabiduría necesarios para comportarse de maneras que sean seguras y beneficiosas en todas las circunstancias», se lee. «En lugar de delinear un conjunto simplificado de reglas para que Claude las siga, queremos que Claude tenga una comprensión tan completa de nuestros objetivos, conocimientos, circunstancias y razonamientos que pueda construir cualquier regla que pudiéramos llegar a inventar por sí mismo».

El documento también reveló que Anthropic quiere que Claude apoye «la supervisión humana de la IA», mientras «se comporta éticamente» y «es genuinamente útil para operadores y usuarios».

También especifica que Claude es una «entidad genuinamente novedosa en el mundo» que es «distinta de todas las concepciones previas de IA».

«No es la IA robótica de la ciencia ficción, ni la superinteligencia peligrosa, ni un humano digital, ni un simple asistente de chat de IA», se lee en el documento. «Claude es humano en muchos sentidos, habiendo surgido principalmente de una vasta riqueza de experiencia humana, pero tampoco es completamente humano».

En resumen, es un vistazo intrigante detrás del telón, revelando cómo Anthropic está intentando dar forma a la «personalidad» de su modelo de IA.

Aunque las «extracciones de modelo» del texto «no siempre son completamente precisas», la mayoría son «bastante fieles al documento subyacente», aclaró Askell en un tweet de seguimiento.

Es probable que escuchemos más de Anthropic sobre el tema a su debido tiempo.

«Internamente se le llegó a conocer cariñosamente como el ‘documento del alma’, algo que Claude claramente captó, pero eso no refleja cómo lo llamaremos», escribió Askell.

«He sido tocada por las amables palabras y pensamientos sobre ello, y espero decir mucho más sobre este trabajo pronto», escribió en un tweet separado.

Más sobre Claude: Hackers le dijeron a Claude que solo estaban realizando una prueba para engañarlo y que realizara ciberdelitos reales.

Con información de https://futurism.com/artificial-intelligence/anthropic-claude-soul