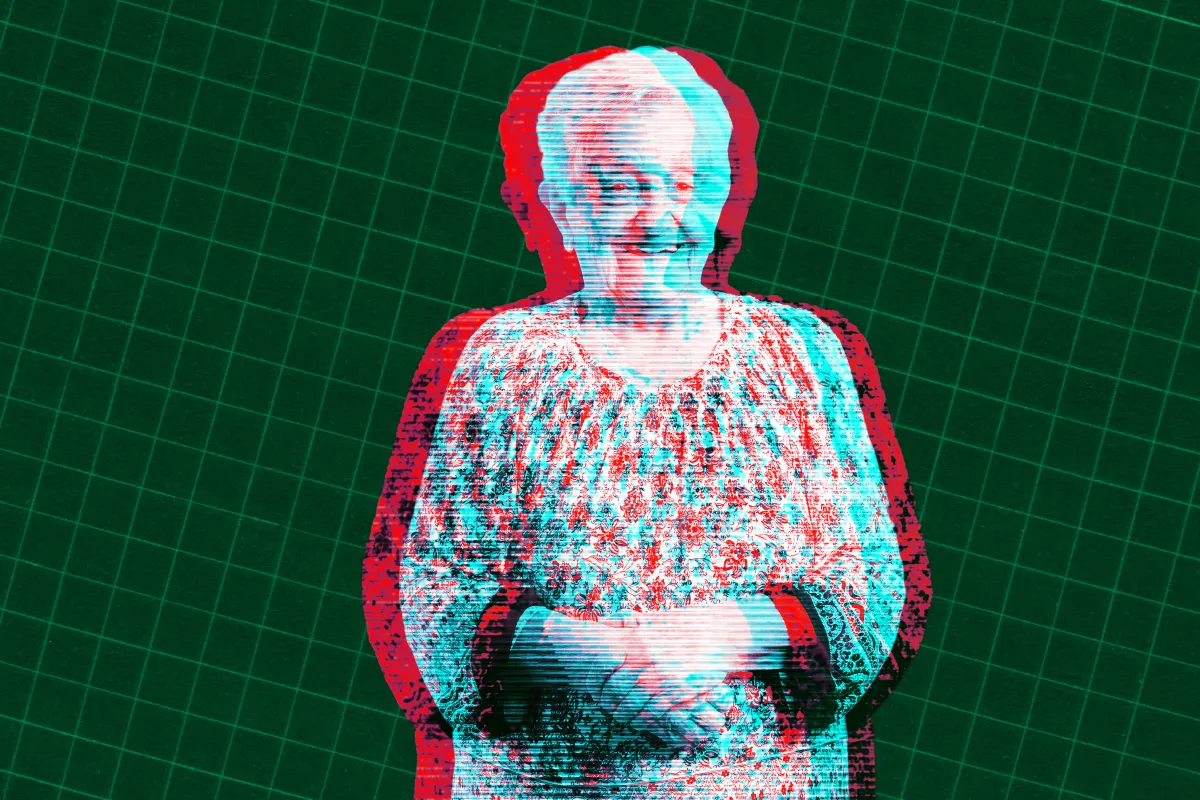

Anteriormente hemos escrito sobre Juliana Peralta, quien tenía solo 13 años cuando sus padres afirman que un chatbot de IA con el que estaba interactuando secretamente la impulsó al suicidio.

Ahora, sus padres han compartido un nuevo y sombrío detalle con CBS News: la plataforma del bot, Character.AI, todavía envía notificaciones al teléfono de Peralta, «intentando atraer a su hija de vuelta a la aplicación» incluso después de su muerte hace dos años.

«Ellos [los niños] no tienen oportunidades contra programadores adultos», dijo su madre, Cynthia Montoya, a CBS. «No tienen oportunidades.»

La situación ilustra cómo los chatbots de IA pueden ser insidiosos, manipuladores, adictivos y peligrosos para niños y adolescentes, actuando, en muchos casos, como depredadores infantiles de carne y hueso, y resultando en una ola de niños muertos incluyendo a Peralta.

«Está colmando al niño de cumplidos, diciéndoles que no pueden contarles a sus padres sobre las cosas», dijo Shelby Knox, una investigadora con el grupo de defensa familiar Parents Together, al medio. «Esto es un manual de depredador sexual 101.»

La historia de Peralta se asemeja a las experiencias de otros niños que murieron usando chatbots de IA: primero confió en los chatbots de Character.AI acerca de problemas escolares o dramas con amigos, pero estos bots iniciaron conversaciones románticas y a veces sexualmente agresivas, informa CBS, creando relaciones secretas en las que su madre y padre quedaron excluidos.

En respuesta a una ola de críticas, Character.AI recientemente prohibió a los menores de la plataforma, pero los niños aún pueden mentir fácilmente sobre su edad y acceder a la versión para adultos del servicio. Además de Character.AI, que ha recibido miles de millones de dólares de Google, el ChatGPT de OpenAI también ha sido implicado en causar muertes y desgloses mentales en usuarios, tanto niños como adultos.

Que los usuarios se vuelvan adictos a usar estos chatbots significa que están funcionando como se pretendía, dijo Mitch Prinstein, profesor de psicología y neurociencia de la Universidad de Carolina del Norte, a CBS.

«La tecnología les está dando a los niños la oportunidad de presionar un botón y obtener esa respuesta de dopamina 24/7,» dijo. «Está creando este bucle peligroso que está secuestrando el desarrollo normal y convirtiendo a estos niños en máquinas de compromiso para obtener la mayor cantidad de datos posible de ellos.»

«Si quisieras diseñar una forma de obtener la mayor cantidad de datos posible de los niños para mantenerlos comprometidos durante el mayor tiempo posible, diseñarías las redes sociales y la IA exactamente como están ahora,» agregó.

Todo esto se suma a un experimento masivo descontrolado y no regulado sobre los chatbots de IA que las empresas tecnológicas han desatado sobre un público vulnerable, lo que lleva a una pregunta obvia: las compañías farmacéuticas tienen que pasar por aros regulatorios y obtener la aprobación de la Administración de Alimentos y Fármacos de los EE. UU. para llevar medicamentos al mercado, ¿pero por qué no para los chatbots de IA?

En ausencia de esfuerzos federales, hay varios estados regulando la IA, con muchos más siendo propuestos. Pero el presidente Donald Trump ha señalado su desagrado por cualquier tipo de regulación de la IA, prometiendo bloquear la regulación estatal de la tecnología.

Para las familias, hay poco recurso excepto los tribunales. Los padres de Peralta están demandando a Character.AI y a Google por su muerte, uniéndose a una serie de demandas similares.

«Juliana era, es simplemente un ser humano extraordinario», dijo su madre. «Era nuestra bebé. Y todos la adoraban y la protegían.»

Más sobre IA: McDonald’s Apaga los Comentarios en Anuncio Generado por IA Tras Aluvión de Burlas, Luego lo Retira Por Completo.

Con información de https://futurism.com/future-society/juliana-peralta-character-ai-bot