La IA generativa ha facilitado más que nunca la suplantación de identidad de otras personas, desde estafadores utilizando voces clonadas de objetivos para estafas de phishing hasta deepfakes de celebridades fallecidas circulando en la aplicación Sora de OpenAI.

Incluso el astrónomo de Harvard Avi Loeb, quien ha recibido considerable atención mediática este año por su teoría que levanta cejas sobre que el misterioso objeto interestelar 3I/ATLAS podría ser una nave espacial alienígena visitando el sistema solar, ha caído víctima de la tendencia.

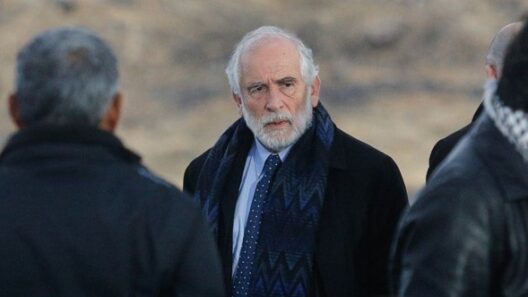

Un canal de YouTube llamado «Dr. Avi Loeb» está suplantando al investigador al parecer utilizando herramientas de IA generativa para clonar tanto su apariencia como su voz, sugiriendo que el tema ha despertado suficiente interés público para ser lucrativo para los estafadores.

«De hecho, estos videos son falsos, producidos por IA», confirmó Loeb en un correo electrónico a Futurism. «Los he reportado a YouTube.»

A diferencia de Loeb, quien ha especulado que 3I/ATLAS y otros objetos interestelares podrían tener orígenes tecnológicos mientras reconoce que es probable que solo sean objetos que ocurren de manera natural, los videos en el canal de YouTube son extremadamente sensacionalistas, con títulos como «3I/ATLAS es una SONDA – Nuevos datos no dejan lugar a dudas.»

En un adendum a su última entrada de blog, que discute las imágenes más recientes del Telescopio Espacial Hubble de 3I/ATLAS, Loeb exploró las implicaciones más amplias de ser suplantado.

«Imagina crear videos que presenten avatares de científicos que se parezcan a ellos y hablen con su voz, pero difundan información contraria a los hechos sobre 3I/ATLAS», escribió. «¿Cómo sabría el público en quién creer?»

«Esto no es una trama de una novela de ciencia ficción sino la realidad a la que nos enfrentamos hoy», agregó Loeb. «En las últimas dos semanas, recibí cientos de correos electrónicos de fanáticos que notaron un canal de YouTube con mi nombre, con videos falsos sobre el objeto interestelar 3I/ATLAS, creados por inteligencia artificial.»

Aparte de algunos movimientos bruscos muy extraños, los videos en la página de YouTube también muestran un reloj que está «congelado en una hora específica» en el fondo, como señaló Loeb, en otra pista de que fueron manipulados y posiblemente renderizados por IA.

«Responsabilizo legalmente a la entidad que creó los videos falsos por difamación y contenido falso», agregó en su blog. «Hasta ahora, mis fans y yo hemos presentado docenas de informes a YouTube, pero la compañía no ha asumido la responsabilidad de resolver este asunto.»

El canal probablemente esté violando los términos de servicio de YouTube. La política de suplantación de la compañía prohíbe cualquier «contenido destinado a suplantar a una persona o canal».

«Si tu contenido viola esta política, podemos terminar tu canal o cuenta», advierte la política.

Futurism contactó a YouTube, pero no recibió respuesta al cierre de esta edición.

En cuanto a por qué alguien se tomaría todo el esfuerzo de suplantarle, Loeb ofreció una posibilidad.

«Los creadores pueden ganar dinero con publicidad de un canal de YouTube», le dijo a Futurism en un correo electrónico de seguimiento. «Tengo una base de fanáticos muy grande con más de 5 millones de lectores por mes de mis ensayos en Medium.com.»

«Otra motivación podría ser la desinformación», añadió.

Hasta la fecha, el canal de YouTube ofensivo, que fue creado en septiembre, ha acumulado más de 1.4 millones de vistas. Si se monetizó, la cuenta podría haber ganado entre $14,000 y $42,000, asumiendo un pago de uno a tres centavos por vista.

La cuenta comenzó a suplantar a Loeb el 24 de noviembre. Antes de eso, había estado subiendo contenido en tagalo que presentaba a un hombre con una bata de laboratorio, identificado como «Dr. Ricardo Reyes», quien daba consejos de salud como recomendar tratamientos naturales para la diabetes.

En resumen, es un punto de inflexión extraño que establece un precedente preocupante, con plataformas que se demoran en eliminar claras suplantaciones de IA.

«Vivimos en una nueva realidad donde el contenido falso puede ser generado fácilmente por IA», escribió Loeb en su blog. «Esto plantea un problema serio sobre cómo autenticar la validez de la información en internet.»

«La ciencia se enfoca en descubrir la realidad física basada en hechos», añadió. «El némesis de la ciencia es el contenido falso creado por IA.»

Más sobre Loeb: El misterioso objeto interestelar parece estar palpando en un «patrón de latidos del corazón».

Con información de https://futurism.com/artificial-intelligence/ai-fake-avi-loeb-youtube