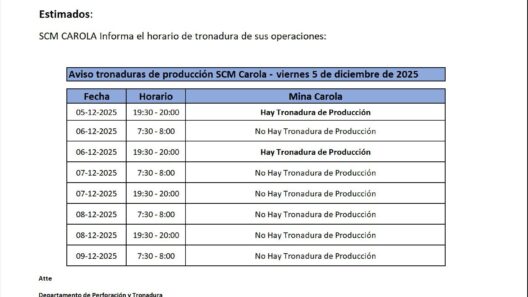

Un activista anti-IA en California ha estado desaparecido durante aproximadamente dos semanas, según The Atlantic, y ahora sus amigos están preocupados por su seguridad, mientras que la policía de San Francisco teme que pueda atacar a empleados de OpenAI.

El activista en cuestión, un joven de 27 años llamado Sam Kirchner, ayudó a iniciar el grupo Stop AI el año pasado con un compromiso hacia la protesta no violenta, pero se frustró y enojó porque los esfuerzos del grupo no avanzaban lo suficientemente rápido o lo suficientemente lejos, ya que veía cada vez más a la IA como una amenaza existencial inminente para la humanidad, según el informe de la revista.

Eso eventualmente llevó a Kirchner a separarse del grupo y desaparecer después de agredir al actual líder de Stop AI; la policía de la ciudad luego recibió llamadas que «advertían que Kirchner había amenazado específicamente con comprar armas de alto poder y matar personas en OpenAI», informa The Atlantic.

La situación de Kirchner es claramente extrema, pero quizás no del todo sorprendente, ya que la IA sacude a la sociedad, provocando narrativas de desastre, incluso entre sus defensores más ardientes, como el CEO de OpenAI, Sam Altman.

«Existe este tipo de mentalidad apocalíptica en la que las personas pueden entrar», dijo Émile P. Torre —un filósofo, historiador y conocido de Kirchner— a The Atlantic. «Los riesgos son enormes y literalmente no podrían ser más altos. Ese tipo de retórica está por todas partes en Silicon Valley».

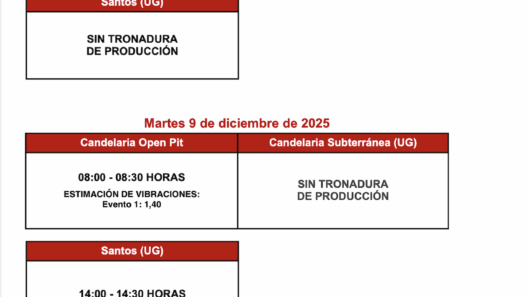

El descenso de Kirchner parece haber comenzado el mes pasado cuando tuvo un enfrentamiento con miembros de Stop AI, que es una de las varias organizaciones o confederaciones en línea escépticas de la IA que han surgido en los últimos años. La misión de Stop AI es presionar por una «prohibición global permanente del desarrollo de superinteligencia artificial», informa The Atlantic.

Kirchner no estaba de acuerdo con el mensaje de Stop AI para una protesta y luego golpeó a Matthew “Yakko” Hall, el líder actual del grupo, después de que Kirchner intentara acceder a los fondos de la caja de Stop AI. Los miembros luego encontraron su apartamento en West Oakland vacío y se enteraron de que la policía de la ciudad emitió una alerta interna sobre Kirchner, siendo armado y peligroso y una posible amenaza para los empleados de OpenAI; sus oficinas se cerraron con candado el mes pasado como resultado.

Los miembros de Stop AI no creen que sea un peligro público y están más preocupados por su salud mental y física. Lo más probable es que se esté refugiando sintiéndose herido y avergonzado, le dijeron a la revista. Sin embargo, algunas de sus últimas palabras a Yakko fueron que el «barco de la no violencia ya zarpó para mí».

«Tenía el peso del mundo sobre sus hombros», dijo el organizador de Stop AI Wynd Kaufmyn a The Atlantic.

Un ejemplo más extremo de un grupo escéptico de la IA es los Zizians, un culto que se volvió temeroso de que la IA pudiera acabar con la humanidad y que ha sido implicado en varios asesinatos, aunque esos casos no tienen nada que ver con la IA. Otro es Pause AI, que «aboga por una pausa en el desarrollo de IA superinteligente hasta que pueda avanzar de manera segura, o en ‘alineación’ con resultados ideales decididos democráticamente».

Es difícil decir cuánto realmente está preparada la IA para cambiar la sociedad. Es posible que sus capacidades pronto lleguen a un muro, o que continúe fortaleciéndose hasta que amenace el orden económico y social, o incluso que la IA superinteligente pueda representar una amenaza para la humanidad. Esa última posibilidad no es una posición completamente marginal; el intelectual público Eliezer Yudkowsky, por ejemplo, publicó recientemente un libro titulado «Si alguien lo construye, todos mueren: Por qué la IA Superhumana Nos Mataría», que se convirtió inmediatamente en un bestseller en septiembre.

Además de los activistas de seguridad de la IA y los extremistas, incluso los líderes de las empresas tecnológicas que están impulsando la última IA pueden sonar como agoreros, como el CEO de Anthropic, Dario Amodei, y el CEO de OpenAI, Sam Altman. Claro, todo podría ser exageración de marketing, pero las personas toman estas predicciones en serio, lo que ha hecho inadvertidamente que estas compañías y líderes sean objetivos a los ojos de masas descontentas que se sienten excluidas, sus vidas dictadas por personas ricas que no son responsables de sus acciones.

«Me he preocupado por personas en el grupo de seguridad de la IA recurriendo a la violencia», dijo Torres, reflexionando sobre la historia de Kirchner. «Alguien puede tener esa mentalidad y comprometerse con la no violencia, pero la mentalidad inclina a las personas a pensar, Bueno, quizás cualquier medida podría justificarse».

Con información de https://futurism.com/artificial-intelligence/anti-ai-activist-danger